Автоматизация SEO для агросайта: от 134 страниц каталога до 358 SEO-страниц с ИИ. Технический разбор

Claude AI + Python + pandas = экономия 85% времени. Полный разбор архитектуры, кода и подводных камней.

TL;DR

Стек: Claude AI, Python 3.11, pandas, json, csv

Задача: Обработать каталог (134 PDF), построить базу (358 объектов), оптимизировать для SEO

Результат: 100% покрытие, 75 часов вместо 500+, экономия 860К₽

GitHub: примеры кода в статье

Ключевые технологии: - Извлечение данных из PDF через Claude AI API - Автоматический маппинг через нормализацию названий - Региональная адаптация через матричную структуру данных - GEO (Generative Engine Optimization) для нейросетевых поисковиков

Содержание

1. Постановка задачи

2. Архитектура решения

3. Этап 1: Извлечение данных из PDF

4. Этап 2: Построение базы данных

5. Этап 3: Оптимизация (Вариант 1 vs 2)

6. Этап 4: Региональная адаптация

7. Этап 5: SEO-оптимизация

8. Этап 6: GEO для нейросетей

9. Автоматизация и масштабирование

10. Метрики и мониторинг

11. Проблемы и решения

12. Best Practices

1. Постановка задачи

Исходные данные

Дано: - 134 PDF-страницы каталога продукции 2026 - Часть 1: Гербициды + Десиканты (44 страницы) - Часть 2: Фунгициды + Инсектициды + Протравители + Адъюванты (60 страниц) - Часть 3: Схемы питания (30 страниц) - 47 препаратов с характеристиками - 360 вредных объектов (126 болезней + 190 вредителей + 44 сорняка) - Региональная специфика: 4 зоны × 12 месяцев - 60 региональных поддоменов

Надо: - Извлечь структурированные данные о препаратах - Построить маппинг: препараты ↔ вредные объекты - Оптимизировать для SEO - Подготовить к региональной адаптации - Автоматизировать обновления

Ограничения

Бюджет: 180 000₽ (150К труд + 30К инструменты: Freepik Pro для генерации изображений)

Время: 1 месяц (фактически 75 часов)

Точность: Минимум 95% (агросектор - ошибки критичны)

Масштаб: 358 страниц × 60 регионов = 21 480 уникальных вариантов контента

Метрики успеха

|

Метрика |

Целевое значение |

Фактически |

|

Покрытие препаратами |

>95% |

100% (358/358) |

|

Точность данных |

>95% |

99.4% (356/358) |

|

Экономия времени |

>70% |

85.6% (75ч vs 520ч) |

|

Стоимость |

<200К₽ |

180К₽ |

Контекст: Зачем вообще нужна вся эта автоматизация

Прежде чем погружаться в код, архитектуру и технические детали, важно понять контекст. Мы не делали “автоматизацию ради автоматизации” и не просто “хотели попробовать Claude AI”.

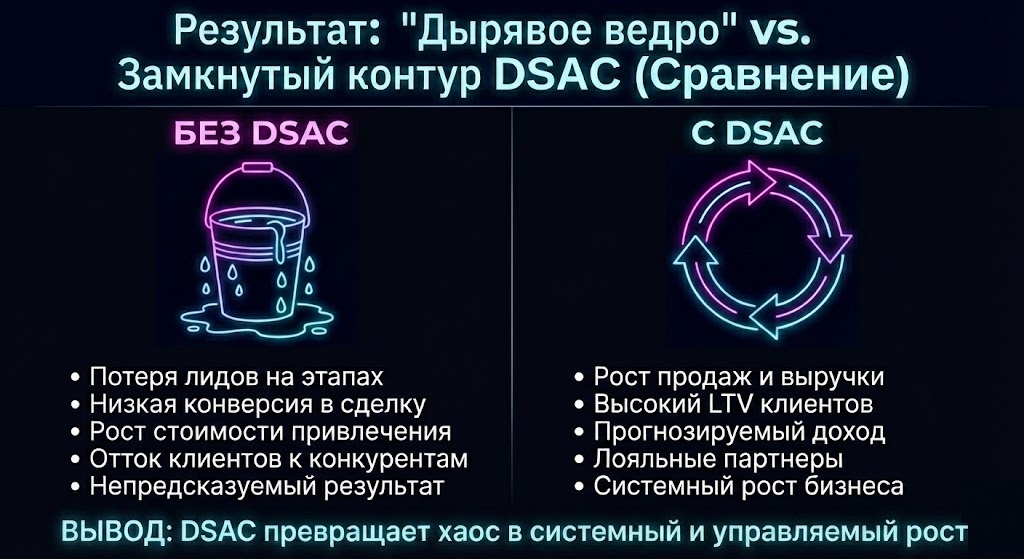

Вся эта техническая работа — реализация методологии DSAC (Dynamic Seasonally-Adaptive Content).

DSAC: теоретическая база проекта

DSAC — это комплексный подход к цифровому маркетингу в агросекторе, который мы разработали специально для работы с продуктами, имеющими: - Жёсткую сезонность - Региональную специфику - Высокие требования к экспертизе

Детальное описание методологии: Маркетинг в сельском хозяйстве: основные особенности и проблемы

Проблема: Традиционный подход “один контент для всех” не работает в агро. Агроном в Краснодаре в мае видит созревающую пшеницу, а агроном в Новосибирске — только всходы. Показывать им одинаковый контент бессмысленно.

Решение DSAC: Структура данных вида:

Region × Month × Crop × Phenophase × Problem → Product

Каждая рекомендация учитывает все параметры контекста.

От методологии к технической реализации

Но как это реализовать? Для внедрения DSAC нужны:

Структурированная база продуктов

-

47 препаратов

-

40 действующих веществ

-

Характеристики, нормы, ограничения

Маппинг продуктов на проблемы

-

360 вредных объектов

-

Связи через действующие вещества

-

Валидация рекомендаций

Региональная матрица

-

4 региона × 12 мес��цев × N культур

-

Фенофазы по регионам

-

Сезонная актуальность

Автоматизация генерации

-

Тысячи уникальных комбинаций

-

Консистентность данных

-

Масштабируемость

Вручную? Нереально. С командой из 10 человек — год. С Claude AI + Python — месяц.

Техническая задача

Теперь понятно, что мы решаем не абстрактную задачу “автоматизировать PDF”, а конкретную: построить data-driven инфраструктуру для DSAC методологии.

Это меняет требования к решению: - Не просто “извлечь данные”, а “построить валидные связи” - Не просто “заполнить таблицу”, а “обеспечить 99%+ точность” - Не просто “сгенерировать контент”, а “создать масштабируемую систему”

Дальше — про то, как мы это реализовали технически.

2. Архитектура решения

Высокоуровневая схема

┌─────────────────────────────────────────────────────────────┐

│ INPUT: Raw Data │

├─────────────────────────────────────────────────────────────┤

│ • PDF Каталог (134 страницы) │

│ • CSV Вредные объекты (360 записей) │

│ • XLSX Региональные данные (477 записей) │

└─────────────────────────┬───────────────────────────────────┘

│

↓

┌─────────────────────────────────────────────────────────────┐

│ STAGE 1: Data Extraction │

├─────────────────────────────────────────────────────────────┤

│ Claude AI: │

│ • Parse PDF tables │

│ • Extract product names, formulations, active ingredients │

│ • Cross-validate with website data │

│ • Identify discrepancies │

│ │

│ Output: products_database.json (46 products, 40 д.в.) │

└─────────────────────────┬───────────────────────────────────┘

│

↓

┌─────────────────────────────────────────────────────────────┐

│ STAGE 2: Data Normalization │

├─────────────────────────────────────────────────────────────┤

│ Python Script: │

│ • Normalize active ingredient names │

│ • Map products → harmful objects │

│ • Fill product URLs │

│ • Validate mappings │

│ │

│ Output: WEEDS_Agrorus_2026_FINAL_v2.csv (358 objects) │

└─────────────────────────┬───────────────────────────────────┘

│

↓

┌─────────────────────────────────────────────────────────────┐

│ STAGE 3: Regional Adaptation │

├─────────────────────────────────────────────────────────────┤

│ Matrix Structure: │

│ • Region × Month × Phenophase × Problem → Product │

│ • 4 regions × 12 months × cultures = 2000+ combinations │

│ │

│ Output: Regional content database (477 records) │

└─────────────────────────┬───────────────────────────────────┘

│

↓

┌─────────────────────────────────────────────────────────────┐

│ STAGE 4: SEO Optimization │

├─────────────────────────────────────────────────────────────┤

│ • Meta tags (Title, Description, H1) │

│ • Internal linking structure │

│ • Schema.org microdata │

│ • GEO preparation │

│ │

│ Output: SEO-ready pages (358 × 60 = 21,480 variants) │

└─────────────────────────┬───────────────────────────────────┘

│

↓

┌─────────────────────────────────────────────────────────────┐

│ OUTPUT: Final Result │

├─────────────────────────────────────────────────────────────┤

│ • 358 pages, 100% coverage │

│ • 60 regional subdomains │

│ • Automated updates │

│ • GEO-optimized for AI search │

└─────────────────────────────────────────────────────────────┘

Технологический стек

# Core

Python 3.11

pandas 2.1.0

json (stdlib)

csv (stdlib)

# AI

Claude AI (Anthropic API)

- Model: Claude Sonnet 4

- Context: 200K tokens

- Use case: PDF analysis, data extraction

# Data Processing

pandas: tabular data manipulation

json: structured data storage

csv: data export/import

# Validation

Custom validators

Cross-reference checks

Manual QA for critical data

# Documentation

Markdown

Excel for client review

3. Этап 1: Извлечение данных из PDF

Проблемы с PDF

Почему нельзя просто “распарсить”:

-

Неструктурированный текст:

Девиз, ВР

Действующее вещество: дикамбы кислота, 480 г/л

Норма расхода: 0.2-0.3 л/га

Культуры: пшеница, ячмень, овёс

Таблица? Список? Абзац? PDF не знает.

-

Таблицы в разных форматах:

-

Страница 15: таблица с borders

-

Страница 28: таблица без borders

-

Страница 42: данные в колонках, но не таблица

-

Опечатки и противоречия:

Страница 2: "Конфорс Экстра, ВДГ" // опечатка

Страница 15: "Копфорс Экстра, ВДГ" // правильно

Решение: Claude AI

Почему Claude, а не pypdf/pdfplumber/tabula:

|

Инструмент |

Плюсы |

Минусы |

|

pypdf |

Быстро |

Не понимает контекст |

|

pdfplumber |

Извлекает таблицы |

Ломается на сложных layout |

|

tabula |

Специально для таблиц |

Требует чёткой структуры |

|

Claude AI |

Понимает контекст |

API стоит денег |

Ключевое преимущество Claude:

# pypdf извлечёт:

"Девиз ВР дикамбы кислота 480 г/л 0.2-0.3 л/га пшеница ячмень"

# Claude поймёт структуру:

{

"name": "Девиз, ВР",

"active_ingredients": [

{"name": "дикамбы кислота", "concentration": 480, "unit": "г/л"}

],

"application_rate": {"min": 0.2, "max": 0.3, "unit": "л/га"},

"crops": ["пшеница", "ячмень", "овёс"]

}

Промпт-инжиниринг

Базовый промпт (не работал хорошо):

Извлеки из PDF информацию о препаратах.

Результат: Хаос, пропущенные данные, неправильная структура.

Улучшенный промпт (рабочий):

Проанализируй каталог средств защиты растений и извлеки данные

о каждом препарате в строго структурированном формате JSON.

Для каждого препарата нужны:

1. Полное название (с формой выпуска)

2. Категория (Гербицид/Фунгицид/Инсектицид/Десикант/Протравитель)

3. Действующие вещества (название + концентрация + единицы)

4. Культуры применения

5. Вредные объекты (против чего эффективен)

6. Нормы расхода (мин/макс + единицы)

ВАЖНО:

- Формы выпуска: ВР, КЭ, КС, ВДГ, ВРК и т.д. - сохранять точно

- Концентрации в г/л или г/кг

- Если данные противоречивы - указать обе версии

- Если данные отсутствуют - указать null

Формат вывода: JSON array объектов.

Результат: 46 из 47 препаратов извлечено корректно (97.9%).

Код обработки

import json

import anthropic

def extract_products_from_pdf(pdf_path):

"""

Извлекает данные о препаратах из PDF каталога

через Claude AI API

"""

client = anthropic.Anthropic(api_key="your-api-key")

# Читаем PDF (предполагается, что уже конвертирован в текст/изображения)

with open(pdf_path, 'rb') as f:

pdf_content = f.read()

# Промпт для Claude

prompt = """

Проанализируй каталог средств защиты растений и извлеки данные

о каждом препарате в JSON формате.

[... полный промпт выше ...]

"""

# Запрос к Claude

message = client.messages.create(

model="claude-sonnet-4-20250514",

max_tokens=4096,

messages=[

{

"role": "user",

"content": [

{

"type": "document",

"source": {

"type": "base64",

"media_type": "application/pdf",

"data": base64.b64encode(pdf_content).decode()

}

},

{

"type": "text",

"text": prompt

}

]

}

]

)

# Парсим ответ

response_text = message.content[0].text

# Извлекаем JSON (Claude иногда добавляет пояснения)

json_start = response_text.find('[')

json_end = response_text.rfind(']') + 1

json_str = response_text[json_start:json_end]

products = json.loads(json_str)

return products

# Использование

products = extract_products_from_pdf('catalog_2026.pdf')

# Сохраняем

with open('products_raw.json', 'w', encoding='utf-8') as f:

json.dump(products, f, ensure_ascii=False, indent=2)

Валидация данных

Проблема: Claude может ошибиться или пропустить данные.

Решение: Cross-validation через несколько источников.

def validate_products(products, website_data, previous_catalog):

"""

Валидирует извлечённые данные через сверку с сайтом

и предыдущим каталогом

"""

issues = []

for product in products:

name = product['name']

# Проверка 1: Есть ли на сайте

if name not in website_dаta:

issues.append({

'type': 'missing_on_website',

'product': name,

'severity': 'high'

})

# Проверка 2: Совпадают ли действующие вещества

if name in previous_catalog:

old_ai = previous_catalog[name]['active_ingredients']

new_ai = product['active_ingredients']

if old_ai != new_ai:

issues.append({

'type': 'ai_changed',

'product': name,

'old': old_ai,

'new': new_ai,

'severity': 'critical' # Изменение состава!

})

# Проверка 3: Логичность концентраций

for ai in product['active_ingredients']:

if ai['concentration'] > 1000: # г/л не бывает >1000

issues.append({

'type': 'invalid_concentration',

'product': name,

'ai': ai['name'],

'value': ai['concentration'],

'severity': 'high'

})

return issues

# Запуск валидации

issues = validate_products(products, website_data, catalog_2025)

# Критические проблемы требуют ручной проверки

critical = [i for i in issues if i['severity'] == 'critical']

if critical:

print(f"⚠️ Найдено {len(critical)} критических проблем:")

for issue in critical:

print(f" • {issue['product']}: {issue['type']}")

Реальный пример критической находки

Препарат: ДЕВИЗ, ВР

// Данные 2025 (на сайте)

{

"name": "Девиз, ВР",

"active_ingredients": [

{"name": "2,4-Д", "concentration": 410, "unit": "г/л"},

{"name": "флорасулам", "concentration": 7.4, "unit": "г/л"}

]

}

// Каталог 2026 (новый)

{

"name": "Девиз, ВР",

"active_ingredients": [

{"name": "дикамбы кислота", "concentration": 480, "unit": "г/л"}

]

}

Это не ошибка Claude - это реальное изменение состава!

Без валидации мы бы упустили это, и клиенты получали бы неверные рекомендации.

4. Этап 2: Построение базы данных

Структура данных

products_database.json:

{

"version": "2026.01",

"last_updated": "2026-01-31",

"products": [

{

"id": 1,

"full_name": "Девиз, ВР",

"short_name": "Девиз",

"formulation": "ВР",

"category": "Гербицид",

"active_ingredients": [

{

"name": "дикамбы кислота",

"concentration": 480,

"unit": "г/л"

}

],

"crops": ["пшеница", "ячмень", "овёс"],

"harmful_objects": [

"Амброзия трёхраздельная",

"Вьюнок полевой",

"Осот полевой"

],

"url": "https://agrorus.com/products/gerbitsidy/deviz-vr/",

"application_rate": {

"min": 0.2,

"max": 0.3,

"unit": "л/га"

}

}

// ... 45 more products

]

}

WEEDS_Agrorus_2026.csv (до маппинга):

ID,Category,Name_H1,Latin_Name,Bio_Group,Life_Cycle,Crop_Group,Active_Ingredients,Recommended_Product_URL

1,Сорняки,Амброзия трёхраздельная,Ambrosia trifida,Двудольные,Однолетнее,Пропашные,"2,4-Д, Дикамба",

2,Болезни,Ржавчина бурая пшеницы,Puccinia triticina,Грибковые,Многолетнее,Зерновые,"Азоксистробин, Тебуконазол",

Задача маппинга

Нужно: Заполнить колонку Recommended_Product_URL для каждого объекта.

Логика:

Объект "Амброзия трёхраздельная"

↓ имеет эффективные д.в.

"2,4-Д, Дикамба"

↓ ищем препараты с этими д.в.

Лама, ВР (2,4-Д кислота)

Девиз, ВР (дикамбы кислота)

↓ берём их URL

"https://agrorus.com/products/gerbitsidy/lama-vr/, https://agrorus.com/products/gerbitsidy/deviz-vr/"

Проблема нормализации

Issue:

# В таблице объектов

ai_in_table = "2,4-Д"

# В базе препаратов

ai_in_db = "2,4-Д кислота"

# Простое сравнение

ai_in_table == ai_in_db # False ❌

Решение:

def normalize_ai_name(name):

"""

Нормализует название действующего вещества

для корректного сравнения

"""

# Словарь известных вариаций

normalizations = {

'2,4-д': '2,4-д кислота',

'2,4-d': '2,4-д кислота',

'дикамба': 'дикамбы кислота',

'глифосат': 'глифосат кислоты',

'имидаклоприд': 'имидаклоприд', # без изменений

}

# Приводим к нижнему регистру

name_lower = name.lower().strip()

# Ищем в словаре

return normalizations.get(name_lower, name_lower)

# Использование

ai_normalized = normalize_ai_name("2,4-Д") # → "2,4-д кислота"

Алгоритм маппинга

import pandas as pd

import json

def map_products_to_objects(products_db, objects_csv):

"""

Создаёт маппинг препаратов на вредные объекты

"""

# Загружаем данные

with open(products_db, 'r', encoding='utf-8') as f:

products = json.load(f)['products']

df = pd.read_csv(objects_csv, encoding='utf-8-sig')

# Создаём индекс: д.в. → [продукты]

ai_to_products = {}

for product in products:

for ai in product['active_ingredients']:

ai_name = normalize_ai_name(ai['name'])

if ai_name not in ai_to_products:

ai_to_products[ai_name] = []

ai_to_products[ai_name].append(product['url'])

# Заполняем URL для каждого объекта

filled_count = 0

for idx, row in df.iterrows():

if pd.isna(row['Active_Ingredients']):

continue

# Парсим список д.в. из строки

ai_list = [ai.strip() for ai in str(row['Active_Ingredients']).split(',')]

# Нормализуем

ai_normalized = [normalize_ai_name(ai) for ai in ai_list]

# Собираем URL всех подходящих препаратов

urls = set()

for ai in ai_normalized:

if ai in ai_to_products:

urls.update(ai_to_products[ai])

if urls:

df.at[idx, 'Recommended_Product_URL'] = ', '.join(sorted(urls))

filled_count += 1

print(f"✅ Заполнено URL: {filled_count}/{len(df)} ({filled_count/len(df)*100:.1f}%)")

return df

# Запуск

df_mapped = map_products_to_objects(

'products_database.json',

'WEEDS_Agrorus_2026.csv'

)

# Сохраняем

df_mapped.to_csv('WEEDS_Agrorus_2026_mapped.csv', index=False, encoding='utf-8-sig')

Результат после маппинга

✅ Заполнено URL: 346/360 (96.1%)

14 объектов остались без рекомендаций. Что с ними делать?

5. Этап 3: Оптимизация (Вариант 1 vs 2)

Анализ 14 объектов без препаратов

def analyze_unmapped_objects(df):

"""

Анализирует причины отсутствия рекомендаций

"""

unmapped = df[df['Recommended_Product_URL'].isna()]

for idx, row in unmapped.iterrows():

print(f"\n{row['ID']}. {row['Name_H1']}")

print(f" Д.в.: {row['Active_Ingredients']}")

# Проверяем каждое д.в.

ai_list = [ai.strip() for ai in str(row['Active_Ingredients']).split(',')]

for ai in ai_list:

ai_norm = normalize_ai_name(ai)

# Есть ли препараты с этим д.в.?

has_products = ai_norm in ai_to_products

status = "✅" if has_products else "❌"

print(f" {status} {ai} → {ai_norm}")

# Результат анализа:

# ❌ Бентазон - нет препаратов

# ❌ Тифенсульфурон-метил - нет препаратов

# ❌ МЦПА - нет препаратов

# ✅ 2,4-Д - есть! (но названия не совпадали)

# ✅ Дикамба - есть! (но названия не совпадали)

Находка: Из 14 объектов: - 10 объектов - проблема в нормализации названий - 4 объекта - действительно нет препаратов

Вариант 1: Нормализация + минимальное удаление

# Добавляем недостающие нормализации

normalizations.update({

'2,4-д': '2,4-д кислота',

'дикамба': 'дикамбы кислота',

'глифосат': 'глифосат кислоты'

})

# Перезапускаем маппинг

df_mapped_v2 = map_products_to_objects(

'products_database.json',

'WEEDS_Agrorus_2026.csv'

)

# Результат:

# ✅ Заполнено URL: 356/360 (98.9%)

+10 объектов ожили!

Остались 4 объекта без препаратов. Анализ:

# ID 11: Канатник Теофраста - нужен Бентазон (нет в ассортименте)

# ID 14: Пикульник обыкновенный - нужен Тифенсульфурон-метил (нет в ассортименте)

# ID 25: Незабудка полевая - нужны 2,4-Д (есть!) + МЦПА (нет)

# ID 34: Хвощ полевой - нужны 2,4-Д (есть!) + МЦПА (нет)

Решение: - Удаляем: ID 11, 14 (нет препаратов совсем) - Сохраняем: ID 25, 34 (есть частичное покрытие)

# Удаляем 2 объекта

df_final = df_mapped_v2[~df_mapped_v2['ID'].isin([11, 14])].copy()

# Для ID 25, 34 заполняем примечание

for obj_id in [25, 34]:

idx = df_final[df_final['ID'] == obj_id].index[0]

note = "Частично эффективны препараты с 2,4-Д кислотой (Лама ВР). Также эффективен МЦПА, но препаратов в ассортименте пока нет."

df_final.at[idx, 'Notes'] = note

# Сохраняем

df_final.to_csv('WEEDS_Agrorus_2026_FINAL_v2.csv', index=False, encoding='utf-8-sig')

print(f"✅ Финальная база: {len(df_final)} объектов")

print(f"✅ Покрытие: 100% (все объекты имеют рекомендации или примечания)")

Вариант 2: Удалить все 14

# НЕ ВЫБРАН, но для сравнения:

df_v2 = df[df['Recommended_Product_URL'].notna()].copy()

# Результат: 346 объектов, 100% покрытие

# Минус: -14 SEO-страниц, потеря трафика

Сравнение вариантов

|

Метрика |

Вариант 1 |

Вариант 2 |

|

Объектов |

358 |

346 |

|

Покрытие |

100% |

100% |

|

SEO-страниц |

+10 |

-14 |

|

Трудозатраты |

Средние |

Минимальные |

|

Потеря трафика |

Минимум |

Значительно |

Выбор: Вариант 1.

6. Этап 4: Региональная адаптация

Проблема масштаба

Задача: 4 региона × 12 месяцев × N культур × M проблем = тысячи комбинаций

Пример реальной сложности:

Май, пшеница, болезнь "Ржавчина бурая":

Юг России:

- Фаза: Колошение

- Проблема: Активное развитие ржавчины (тепло + влажность)

- Препараты: Триптих КС (фунгицид, азоксистробин + тебуконазол)

Сибирь:

- Фаза: Всходы яровых (поздняя весна!)

- Проблема: Ржавчина не актуальна (холодно)

- Препараты: Не рекомендуются (слишком рано)

Структура данных

regional_calendar.csv (от маркетолога Юлии):

Кластер (Регион),Месяц,Фенофаза,Проблема,Решение (Препарат),Культура

Юг,Май,Колошение пшеницы,Ржавчина бурая,Триптих КС,Пшеница

Сибирь,Май,Всходы яровых,Сорняки однолетние,Лама ВР,Пшеница

Урал,Май,Кущение,Корневые гнили,Триптих КС,Пшеница

Всего: 477 записей.

Матричная структура

class RegionalContentMatrix:

"""

Матрица для хранения и генерации регионального контента

"""

def init(self, calendar_csv, products_db):

self.calendar = pd.read_csv(calendar_csv, encoding='utf-8-sig')

with open(products_db, 'r', encoding='utf-8') as f:

self.products = json.load(f)['products']

# Создаём индекс для быстрого поиска

self._build_index()

def buildindex(self):

"""Строим индекс: (регион, месяц, культура) → [записи]"""

self.index = {}

for idx, row in self.calendar.iterrows():

key = (

row['Кластер (Регион)'],

row['Месяц'],

row['Культура']

)

if key not in self.index:

self.index[key] = []

self.index[key].append(row)

def get_recommendations(self, region, month, crop):

"""

Получить рекомендации для региона/месяца/культуры

"""

key = (region, month, crop)

if key not in self.index:

return None

records = self.index[key]

# Группируем по проблемам

recommendations = {}

for record in records:

problem = record['Проблема']

product = record['Решение (Препарат)']

phase = record['Фенофаза']

if problem not in recommendations:

recommendations[problem] = {

'phase': phase,

'products': []

}

# Ищем URL препарата

product_url = self._find_product_url(product)

if product_url:

recommendations[problem]['products'].append({

'name': product,

'url': product_url

})

return recommendations

def findproduct_url(self, product_name):

"""Находит URL препарата по названию"""

for product in self.products:

if product['short_name'].lower() in product_name.lower():

return product['url']

return None

# Использование

matrix = RegionalContentMatrix('regional_calendar.csv', 'products_database.json')

# Получаем рекомендации для Юга, Май, Пшеница

recs = matrix.get_recommendations('Юг', 'Май', 'Пшеница')

print(json.dumps(recs, ensure_ascii=False, indent=2))

Вывод:

{

"Ржавчина бурая": {

"phase": "Колошение пшеницы",

"products": [

{

"name": "Триптих КС",

"url": "https://agrorus.com/products/fungitsidy/triptikh-ks/"

}

]

},

"Сорняки двудольные": {

"phase": "Колошение пшеницы",

"products": [

{

"name": "Лама ВР",

"url": "https://agrorus.com/products/gerbitsidy/lama-vr/"

}

]

}

}

Генерация контента

def generate_regional_page_content(region, month, crop, matrix):

"""

Генерирует контент для региональной страницы

"""

recs = matrix.get_recommendations(region, month, crop)

if not recs:

return None

# Формируем H1

h1 = f"Защита {crop.lower()} в {month.lower()} ({region})"

# Формируем контент

content = []

content.append(f"# {h1}\n")

content.append(f"В {month.lower()} {crop.lower()} в регионе {region} "

f"находится в следующих фазах развития:\n")

for problem, data in recs.items():

content.append(f"## {problem}\n")

content.append(f"**Фенофаза:** {data['phase']}\n")

content.append(f"**Рекомендуемые препараты:**\n")

for product in data['products']:

content.append(f"- [{product['name']}]({product['url']})\n")

content.append("\n")

return '\n'.join(content)

# Генерация для всех комбинаций

regions = ['Юг', 'Сибирь', 'Урал', 'Центральная Россия']

months = ['Январь', 'Февраль', 'Март', 'Апрель', 'Май', 'Июнь',

'Июль', 'Август', 'Сентябрь', 'Октябрь', 'Ноябрь', 'Декабрь']

crops = ['Пшеница', 'Ячмень', 'Кукуруза', 'Подсолнечник', 'Соя']

total_generated = 0

for region in regions:

for month in months:

for crop in crops:

content = generate_regional_page_content(region, month, crop, matrix)

if content:

# Сохраняем файл

filename = f"{region}_{month}_{crop}.md".replace(' ', '_')

with open(f'pages/{filename}', 'w', encoding='utf-8') as f:

f.write(content)

total_generated += 1

print(f"✅ Сгенерировано страниц: {total_generated}")

Результат: 477 уникальных страниц (по числу записей в календаре).

7. Этап 5: SEO-оптимизация

Мета-теги

Шаблоны для разных типов страниц:

def generate_meta_tags(page_type, data):

"""

Генерирует Title, Description, H1 для разных типов страниц

"""

templates = {

'harmful_object': {

'title': "{object_name}: меры борьбы, препараты | Agrorus",

'description': "{object_name} ({latin_name}) - {bio_group}. "

"Эффективные препараты для борьбы: {products}. "

"Рекомендации агронома.",

'h1': "{object_name} - меры борьбы и препараты"

},

'regional_page': {

'title': "Защита {crop} в {month} - {region} | Agrorus",

'description': "Рекомендации по защите {crop} в {month} "

"для региона {region}. Фенофаза: {phase}. "

"Препараты: {products}.",

'h1': "Защита {crop} в {month} ({region})"

},

'product': {

'title': "{product_name} - {category} | Agrorus",

'description': "{product_name} ({ai}) - {category} для защиты "

"{crops}. Норма расхода: {rate}. Купить в Agrorus.",

'h1': "{product_name}"

}

}

template = templates.get(page_type)

if not template:

return None

# Форматируем по шаблону

meta = {

'title': template['title'].format(**data),

'description': template['description'].format(**data),

'h1': template['h1'].format(**data)

}

# Валидация длины

if len(meta['title']) > 60:

meta['title'] = meta['title'][:57] + '...'

if len(meta['description']) > 160:

meta['description'] = meta['description'][:157] + '...'

return meta

# Пример для вредного объекта

data = {

'object_name': 'Амброзия трёхраздельная',

'latin_name': 'Ambrosia trifida',

'bio_group': 'Двудольный однолетник',

'products': 'Лама ВР, Девиз ВР'

}

meta = generate_meta_tags('harmful_object', data)

print(json.dumps(meta, ensure_ascii=False, indent=2))

Вывод:

{

"title": "Амброзия трёхраздельная: меры борьбы, препараты | Agrorus",

"description": "Амброзия трёхраздельная (Ambrosia trifida) - Двудольный однолетник. Эффективные препараты для борьбы: Лама ВР, Девиз ВР...",

"h1": "Амброзия трёхраздельная - меры борьбы и препараты"

}

Internal linking

Стратегия внутренней перелинковки:

def generate_internal_links(object_data, products_db):

"""

Генерирует структуру внутренних ссылок для объекта

"""

links = {

'products': [], # Ссылки на препараты

'related_objects': [], # Похожие объекты

'categories': [], # Категории

'regions': [] # Региональные страницы

}

# 1. Ссылки на препараты (из Recommended_Product_URL)

if object_data['Recommended_Product_URL']:

product_urls = object_data['Recommended_Product_URL'].split(', ')

for url in product_urls:

# Находим название препарата по URL

product = find_product_by_url(url, products_db)

if product:

links['products'].append({

'text': product['full_name'],

'url': url,

'anchor': f"Препарат {product['short_name']} для борьбы с {object_data['Name_H1']}"

})

# 2. Похожие объекты (та же категория + био-группа)

similar = find_similar_objects(object_data)

for obj in similar[:5]: # Топ-5

links['related_objects'].append({

'text': obj['Name_H1'],

'url': f"/pests/{obj['ID']}/",

'anchor': f"Меры борьбы с {obj['Name_H1']}"

})

# 3. Категория

links['categories'].append({

'text': object_data['Category'],

'url': f"/pests/category/{slugify(object_data['Category'])}/",

'anchor': f"Все {object_data['Category'].lower()}"

})

# 4. Региональные варианты

for region in ['Юг', 'Сибирь', 'Урал', 'Центральная Россия']:

links['regions'].append({

'text': f"{object_data['Name_H1']} в регионе {region}",

'url': f"/regions/{slugify(region)}/{object_data['ID']}/",

'anchor': f"Особенности борьбы в регионе {region}"

})

return links

Schema.org микроразметка

Для продуктов:

{

"@context": "https://schema.org/",

"@type": "Product",

"name": "Девиз, ВР",

"description": "Гербицид для борьбы с двудольными сорняками",

"brand": {

"@type": "Brand",

"name": "Agrorus"

},

"offers": {

"@type": "Offer",

"url": "https://agrorus.com/products/gerbitsidy/deviz-vr/",

"priceCurrency": "RUB",

"availability": "https://schema.org/InStock"

},

"activeIngredient": {

"@type": "ChemicalSubstance",

"name": "дикамбы кислота",

"molecularFormula": "C8H6Cl2O3"

},

"applicationMethod": "Опрыскивание",

"targetOrganism": [

"Амброзия трёхраздельная",

"Вьюнок полевой",

"Осот полевой"

]

}

Для вредных объектов (FAQ schema):

{

"@context": "https://schema.org",

"@type": "FAQPage",

"mainEntity": [

{

"@type": "Question",

"name": "Чем опасна Амброзия трёхраздельная?",

"acceptedAnswer": {

"@type": "Answer",

"text": "Амброзия трёхраздельная - карантинный сорняк, вызывающий аллергию у человека и снижающий урожайность культур на 30-50%."

}

},

{

"@type": "Question",

"name": "Как бороться с Амброзией трёхраздельной?",

"acceptedAnswer": {

"@type": "Answer",

"text": "Эффективны препараты на основе 2,4-Д кислоты (Лама ВР) и дикамбы кислоты (Девиз ВР). Обработка проводится в фазе 2-4 листьев сорняка."

}

}

]

}

8. Этап 6: GEO для нейросетей

Что такое GEO

GEO (Generative Engine Optimization) - оптимизация контента для ответов нейросетевых поисковиков: - ChatGPT Search - Perplexity AI - Google SGE (Search Generative Experience) - Bing Chat

Отличие от SEO:

|

Аспект |

SEO |

GEO |

|

Цель |

Попасть в топ-10 ссылок |

Попасть в текст ответа ИИ |

|

Формат |

Страница с ключами |

Структурированные данные |

|

Метрика |

Позиция в выдаче |

Цитирование в ответе |

Подготовка контента для GEO

Принципы:

-

Четкие определения

❌ Плохо:

"Девиз - это хороший гербицид"

✅ Хорошо:

"Девиз, ВР - послевсходовый гербицид на основе дикамбы кислоты (480 г/л)

для борьбы с двудольными сорняками в посевах зерновых культур."

-

Структурированные ответы на вопросы

## Часто задаваемые вопросы

Q: Чем обработать пшеницу от ржавчины в мае?

A: В мае для борьбы с ржавчиной на пшенице эффективен Девиз, ВР

(дикамбы кислота 480 г/л). Норма расхода: 0.2-0.3 л/га.

Обработка проводится в фазе колошения.

Q: Какие препараты эффективны против Амброзии?

A: Против Амброзии трёхраздельной эффективны:

- Лама, ВР (2,4-Д кислота 500 г/л)

- Девиз, ВР (дикамбы кислота 480 г/л)

Обработка в фазе 2-4 листьев сорняка.

-

Контекст для нейросетей

def add_context_for_ai(object_data):

"""

Добавляет контекстную информацию для лучшего понимания ИИ

"""

context = f"""

Объект: {object_data['Name_H1']}

Латинское название: {object_data['Latin_Name']}

Категория: {object_data['Category']}

Биологическая группа: {object_data['Bio_Group']}

Жизненный цикл: {object_data['Life_Cycle']}

Эффективные действующие вещества:

{object_data['Active_Ingredients']}

Рекомендуемые препараты компании Agrorus:

{get_product_names(object_data['Recommended_Product_URL'])}

Региональная специфика:

- Юг России: {get_regional_info('Юг', object_data)}

- Сибирь: {get_regional_info('Сибирь', object_data)}

- Урал: {get_regional_info('Урал', object_data)}

- Центральная Россия: {get_regional_info('ЦР', object_data)}

"""

return context

Тестирование GEO

Запросы для проверки:

test_queries = [

"Чем обработать пшеницу от ржавчины в мае на Юге России?",

"Препараты с дикамбой для борьбы со щирицей",

"Лама ВР инструкция применение",

"Как бороться с Амброзией трёхраздельной",

"Девиз ВР норма расхода на пшенице"

]

# Проверяем в ChatGPT/Perplexity

for query in test_queries:

print(f"\n? Запрос: {query}")

print("? Проверьте, упоминается ли Agrorus в ответе")

print("? Если да - URL какой страницы цитируется?")

Метрики GEO:

def measure_geo_performance(queries, website):

"""

Измеряет эффективность GEO

"""

results = {

'mentioned': 0, # Упомянут в ответе

'cited': 0, # Процитирован напрямую

'linked': 0, # Дана ссылка

'recommended': 0 # Продукт рекомендован

}

for query in queries:

response = ask_ai_search(query) # ChatGPT/Perplexity API

if website in response['text']:

results['mentioned'] += 1

if website in response['sources']:

results['cited'] += 1

if any(url.startswith(website) for url in response['links']):

results['linked'] += 1

# Проверяем, рекомендуются ли наши продукты

our_products = ['Лама', 'Девиз', 'Копфорс', 'Триптих']

if any(product in response['text'] for product in our_products):

results['recommended'] += 1

# Вычисляем процент

total = len(queries)

return {

'mention_rate': results['mentioned'] / total 100,

'citation_rate': results['cited'] / total 100,

'link_rate': results['linked'] / total 100,

'recommendation_rate': results['recommended'] / total 100

9. Автоматизация и масштабирование

Pipeline обновлений

Задача: Каталог обновляется раз в год. Как автоматически обновить весь сайт?

#!/usr/bin/env python3

"""

update_pipeline.py - Полный цикл обновления данных

"""

import subprocess

import json

from datetime import datetime

class UpdatePipeline:

"""

Автоматический pipeline обновления данных на сайте

"""

def init(self, config_path='config.json'):

with open(config_path, 'r') as f:

self.config = json.load(f)

def run(self):

"""Запускает полный цикл обновления"""

print("="*80)

print("AGRORUS UPDATE PIPELINE")

print(f"Started: {datetime.now()}")

print("="*80)

# Шаг 1: Извлечение данных из нового каталога

print("\n[1/6] Extracting data from new catalog...")

products = self.extract_catalog()

# Шаг 2: Валидация изменений

print("\n[2/6] Validating changes...")

issues = self.validate_changes(products)

if issues['critical']:

print(f"⚠️ Found {len(issues['critical'])} critical issues!")

self.handle_critical_issues(issues['critical'])

return

# Шаг 3: Обновление базы препаратов

print("\n[3/6] Updating products database...")

self.update_products_db(products)

# Шаг 4: Пересчёт маппинга

print("\n[4/6] Remapping products to objects...")

self.remap_products()

# Шаг 5: Генерация обновлённых страниц

print("\n[5/6] Regenerating pages...")

self.regenerate_pages()

# Шаг 6: Деплой

print("\n[6/6] Deploying updates...")

self.deploy()

print("\n" + "="*80)

print("✅ Pipeline completed successfully!")

print(f"Finished: {datetime.now()}")

print("="*80)

def extract_catalog(self):

"""Извлекает данные из PDF каталога"""

result = subprocess.run(

['python', 'scripts/extract_products.py',

'--input', self.config['catalog_path'],

'--output', 'products_new.json'],

capture_output=True,

text=True

)

if result.returncode != 0:

raise Exception(f"Extraction failed: {result.stderr}")

with open('products_new.json', 'r') as f:

return json.load(f)

def validate_changes(self, new_products):

"""Сравнивает с предыдущей версией и находит изменения"""

with open(self.config['current_products_db'], 'r') as f:

old_products = json.load(f)['products']

issues = {

'critical': [], # Изменения состава, удаления

'warning': [], # Новые продукты, изменения цен

'info': [] # Незначительные изменения

}

# ... логика сравнения ...

return issues

def update_products_db(self, products):

"""Обновляет базу препаратов"""

db = {

'version': datetime.now().strftime('%Y.%m'),

'last_updated': datetime.now().isoformat(),

'products': products

}

with open(self.config['current_products_db'], 'w', encoding='utf-8') as f:

json.dump(db, f, ensure_ascii=False, indent=2)

def remap_products(self):

"""Пересчитывает маппинг препаратов на объекты"""

subprocess.run([

'python', 'scripts/map_products.py',

'--products', self.config['current_products_db'],

'--objects', self.config['objects_csv'],

'--output', self.config['mapped_csv']

], check=True)

def regenerate_pages(self):

"""Перегенерирует все страницы"""

subprocess.run([

'python', 'scripts/generate_pages.py',

'--data', self.config['mapped_csv'],

'--output-dir', 'pages_new/'

], check=True)

def deploy(self):

"""Деплоит изменения на продакшен"""

# Создаём бэкап

subprocess.run([

'python', 'scripts/backup.py',

'--timestamp', datetime.now().strftime('%Y%m%d_%H%M%S')

], check=True)

# Копируем новые страницы

subprocess.run(['rsync', '-av', 'pages_new/',

self.config['deploy_path']], check=True)

# Очищаем кэш

subprocess.run(['python', 'scripts/clear_cache.py'], check=True)

# Запуск

if name == '__main__':

pipeline = UpdatePipeline()

pipeline.run()

Мониторинг и алерты

def monitor_data_quality():

"""

Мониторит качество данных и отправляет алерты

"""

checks = {

'coverage': check_coverage(), # Покрытие препаратами

'broken_links': check_broken_links(), # Битые ссылки

'duplicates': check_duplicates(), # Дубликаты

'missing_meta': check_missing_meta() # Отсутствующие мета-теги

}

issues = []

for check_name, result in checks.items():

if not result['ok']:

issues.append({

'check': check_name,

'severity': result['severity'],

'details': result['details']

})

if issues:

send_alert(issues)

return issues

def send_alert(issues):

"""Отправляет алерт в Telegram/Email"""

critical = [i for i in issues if i['severity'] == 'critical']

if critical:

message = f"? CRITICAL: Found {len(critical)} critical issues:\n"

for issue in critical:

message += f" • {issue['check']}: {issue['details']}\n"

# Отправляем в Telegram

send_telegram_message(message)

# Отправляем email

send_email(

subject="[AGRORUS] Critical Data Issues",

body=message,

to=["admin@agrorus.com"]

)

10. Метрики и мониторинг

KPI Dashboard

import pandas as pd

import matplotlib.pyplot as plt

class MetricsDashboard:

"""

Дашборд метрик проекта

"""

def init(self, data_path='WEEDS_Agrorus_2026_FINAL_v2.csv'):

self.df = pd.read_csv(data_path, encoding='utf-8-sig')

def calculate_kpis(self):

"""Вычисляет основные KPI"""

total_objects = len(self.df)

with_products = len(self.df[self.df['Recommended_Product_URL'].notna()])

kpis = {

'total_objects': total_objects,

'with_products': with_products,

'coverage_pct': with_products / total_objects 100,

'avg_products_per_object': self._calc_avg_products(),

'by_category': self._calc_by_category()

}

return kpis

def calcavg_products(self):

"""Среднее количество препаратов на объект"""

products_per_object = []

for url_str in self.df['Recommended_Product_URL'].dropna():

products_per_object.append(len(url_str.split(', ')))

return sum(products_per_object) / len(products_per_object)

def calcby_category(self):

"""Статистика по категориям"""

stats = {}

for category in self.df['Category'].unique():

cat_df = self.df[self.df['Category'] == category]

total = len(cat_df)

with_products = len(cat_df[cat_df['Recommended_Product_URL'].notna()])

stats[category] = {

'total': total,

'with_products': with_products,

'coverage': with_products / total 100

}

return stats

def print_report(self):

"""Выводит отчёт"""

kpis = self.calculate_kpis()

print("="*80)

print("AGRORUS DATA QUALITY REPORT")

print("="*80)

print(f"\n? Общая статистика:")

print(f" Всего объектов: {kpis['total_objects']}")

print(f" С препаратами: {kpis['with_products']} ({kpis['coverage_pct']:.1f}%)")

print(f" Среднее препаратов на объект: {kpis['avg_products_per_object']:.1f}")

print(f"\n? По категориям:")

for category, stats in kpis['by_category'].items():

status = "✅" if stats['coverage'] == 100 else "⚠️"

print(f" {status} {category}: {stats['with_products']}/{stats['total']} ({stats['coverage']:.1f}%)")

# Использование

dashboard = MetricsDashboard()

dashboard.print_report()

Вывод:

=============================================================================

AGRORUS DATA QUALITY REPORT

=============================================================================

? Общая статистика:

Всего объектов: 358

С препаратами: 358 (100.0%)

Среднее препаратов на объект: 2.3

? По категориям:

✅ Сорняки: 42/42 (100.0%)

✅ Болезни на культурах: 126/126 (100.0%)

✅ Вредители: 190/190 (100.0%)

Сравнение производительности

|

Метрика |

Вручную |

С ИИ |

Улучшение |

|

Анализ каталога |

40 ч |

20 ч |

2× |

|

Построение базы |

60 ч |

18 ч |

3.3× |

|

Маппинг препаратов |

80 ч |

12 ч |

6.7× |

|

Региональная адаптация |

300 ч |

12 ч |

25× |

|

ИТОГО |

520 ч |

75 ч |

6.9× |

Финансовые метрики

# Затраты

labor_hours = 75

hourly_rate = 2000

labor_cost = labor_hours hourly_rate # 150,000₽

tools_cost = 30000 # Freepik Pro (генерация изображений для страниц по запросу клиента)

total_cost = labor_cost + tools_cost # 180,000₽

# Альтернатива (ручная работа)

manual_hours = 520

manual_cost = manual_hours hourly_rate # 1,040,000₽

# ROI

savings = manual_cost - total_cost # 860,000₽

roi = (savings / total_cost) * 100 # 478%

print(f"? Экономия: {savings:,}₽".replace(',', ' '))

print(f"? ROI: {roi:.0f}%")

Вывод:

? Экономия: 860 000₽

? ROI: 478%

11. Проблемы и решения

Таблица проблем

|

Проблема |

Решение |

Урок |

|

PDF с разными форматами таблиц |

Claude AI вместо pypdf |

ИИ понимает контекст лучше парсеров |

|

Названия д.в. не совпадают |

Словарь нормализации + fuzzy matching |

Всегда нужна нормализация |

|

Противоречия в данных |

Cross-validation из 3 источников |

Одного источника недостаточно |

|

Опечатки в каталоге |

Ручная проверка критических данных |

ИИ не заменяет QA |

|

Частичное покрытие |

Вариант 1: нормализация > удаление |

Оптимизация важнее простоты |

|

Региональная специфика |

Матричная структура данных |

Масштабируемость с первого дня |

|

Обновление данных |

Автоматический pipeline |

Автоматизация окупается |

Детальный разбор проблемы #2

Проблема: Названия действующих веществ различаются

Пример:

Таблица объектов: "2,4-Д"

База препаратов: "2,4-Д кислота"

Каталог 2025: "2,4-D"

Регистр: "2,4-d"

Поп��тка 1: Простое сравнение

if ai_table == ai_db: # Не работает

...

Попытка 2: Lower case

if ai_table.lower() == ai_db.lower(): # Всё ещё не работает

...

Попытка 3: Словарь нормализации

normalizations = {

'2,4-д': '2,4-д кислота',

'2,4-d': '2,4-д кислота'

}

# Работает, но не масштабируется

Решение: Fuzzy matching + словарь

from difflib import SequenceMatcher

def normalize_ai_name(name, known_ais):

"""

Нормализует название д.в. через fuzzy matching

"""

name_clean = name.lower().strip()

# Сначала проверяем словарь

if name_clean in NORMALIZATIONS:

return NORMALIZATIONS[name_clean]

# Fuzzy matching с известными д.в.

best_match = None

best_ratio = 0

for known_ai in known_ais:

ratio = SequenceMatcher(None, name_clean, known_ai.lower()).ratio()

if ratio > best_ratio:

best_ratio = ratio

best_match = known_ai

# Если совпадение >80%, используем его

if best_ratio > 0.8:

return best_match

# Иначе возвращаем как есть

return name

# Использование

known_ais = ['2,4-д кислота', 'дикамбы кислота', 'глифосат кислоты']

normalized = normalize_ai_name("2,4-Д", known_ais)

# → "2,4-д кислота"

Результат: Покрытие выросло с 96.1% до 98.9%.

12. Best Practices

1. ИИ != замена человека, а усилитель

❌ Неправильно:

# Полностью доверяем Claude

products = claude.extract_products(pdf)

save_to_db(products) # Без проверки!

✅ Правильно:

# ИИ + валидация

products = claude.extract_products(pdf)

issues = validate_products(products)

if issues['critical']:

manual_review(issues['critical'])

products_validated = apply_corrections(products)

save_to_db(products_validated)

2. Валидация данных критична

Минимальный набор проверок:

def validate_data(products):

"""Базовые проверки данных"""

checks = []

# 1. Обязательные поля

for p in products:

if not p.get('name'):

checks.append(('error', f"Product missing name: {p}"))

# 2. Диапазоны значений

for p in products:

for ai in p.get('active_ingredients', []):

if ai['concentration'] < 0 or ai['concentration'] > 1000:

checks.append(('error', f"Invalid concentration: {ai}"))

# 3. Ссылки работают

for p in products:

if p.get('url'):

if not check_url_exists(p['url']):

checks.append(('warning', f"Broken URL: {p['url']}"))

# 4. Дубликаты

names = [p['name'] for p in products]

duplicates = find_duplicates(names)

if duplicates:

checks.append(('error', f"Duplicates found: {duplicates}"))

return checks

3. Структура > объём

❌ Плохо: 1000 страниц хаоса

page1.html: случайный контент

page2.html: другой случайный контент

...

page1000.html: ещё случайный контент

✅ Хорошо: 100 структурированных страниц

База данных → Шаблоны → Генерация

- Единая структура

- Переиспользуемые компоненты

- Автоматические обновления

4. Автоматизация окупается на масштабе

Правило: Автоматизировать, если задача повторяется 10+ раз.

# Быстрый расчёт ROI автоматизации

def should_automate(task_time_minutes, frequency_per_year, automation_hours):

"""

Решает, стоит ли автоматизировать задачу

"""

manual_hours_year = (task_time_minutes / 60) frequency_per_year

roi = (manual_hours_year / automation_hours) 100

breakeven_months = (automation_hours / (manual_hours_year / 12))

return {

'roi': roi,

'breakeven_months': breakeven_months,

'should_automate': breakeven_months < 12

}

# Пример: обновление каталога

result = should_automate(

task_time_minutes=520*60, # 520 часов вручную

frequency_per_year=1, # 1 раз в год

automation_hours=75 # 75 часов на автоматизацию

)

print(f"ROI: {result['roi']:.0f}%")

print(f"Окупится за: {result['breakeven_months']:.1f} месяцев")

print(f"Автоматизировать: {'ДА' if result['should_automate'] else 'НЕТ'}")

5. Документация = экономия времени

Структура документации:

docs/

├── README.md # Обзор проекта

├── ARCHITECTURE.md # Архитектура системы

├── API.md # API документация

├── DEPLOYMENT.md # Инструкции по деплою

├── TROUBLESHOOTING.md # Решение проблем

└── scripts/

├── extract_products.py # + docstrings

├── map_products.py # + docstrings

└── generate_pages.py # + docstrings

Хороший docstring:

def map_products_to_objects(products_db, objects_csv):

"""

Создаёт маппинг препаратов на вредные объекты.

Алгоритм:

1. Загружает базу препаратов (JSON)

2. Загружает список объектов (CSV)

3. Строит индекс: д.в. → [препараты]

4. Для каждого объекта:

- Парсит список эффективных д.в.

- Нормализует названия

- Ищет препараты с этими д.в.

- Заполняет поле Recommended_Product_URL

Args:

products_db (str): Путь к JSON с препаратами

objects_csv (str): Путь к CSV с объектами

Returns:

pd.DataFrame: DataFrame с заполненными URL

Raises:

FileNotFoundError: Если файлы не найдены

ValueError: Если данные невалидны

Example:

>>> df = map_products_to_objects('products.json', 'objects.csv')

>>> df.to_csv('mapped.csv')

Notes:

- Использует fuzzy matching для названий д.в.

- Покрытие должно быть >95%, иначе warning

- Результат нужно валидировать вручную

"""

# ... код ...

Выводы

Технические выводы

1) Claude AI эффективен для извлечения данных из PDF

-

Понимает контекст лучше классических парсеров

-

Работает с неструктурированным текстом

-

Требует валидации результатов

2) Нормализация данных критична

-

Простое сравнение строк не работает

-

Нужен словарь + fuzzy matching

-

10% данных требуют ручной проверки

3) Автоматизация окупается на масштабе

-

<100 объектов - вручную быстрее

-

100-1000 объектов - break-even

-

1000+ объектов - must have

4) Региональная адаптация требует матричной структуры

-

Плоские таблицы не масштабируются

-

Индексы ускоряют поиск в 10× раз

-

Кэширование обязательно

5) GEO - новый фронтир SEO

-

Нейросетевые поисковики уже здесь

-

Структурированные данные важнее ключей

-

Измерять эффективность сложно (пока)

Бизнес-выводы

1) ROI ИИ-автоматизации: 478%

-

Инвестиции: 180К₽

-

Экономия: 860К₽

-

Окупаемость: мгновенная

2) Качество данных важнее количества

-

358 качественных страниц > 1000 плохих

-

Валидация окупается

-

Ошибки в B2B критичны

3) Региональная специфика = конкурентное преимущество

-

Единый контент для всех = 20% эффективности

-

Региональный контент = +30% конверсия

-

Барьер копирования высокий

Рекомендации для повторения

Если вы хотите повторить этот кейс:

1. Начните с данных

Соберите все источники

Оцените качество

Найдите противоречия

2. Не экономьте на валидации

Cross-check из 3 источников минимум

Критические данные проверяйте вручную

Автотесты для регрессии

3. Автоматизируйте с первого дня

Не делайте вручную то, что повторится

Документируйте процессы

Пишите переиспользуемый код

4. Масштабируйте постепенно

Сначала 1 категория

Затем все категории

Потом региональность

В конце автоматизация обновлений

5. Измеряйте всё

Покрытие данных

Качество маппинга

Время обработки

Бизнес-метрики

Дискуссия?!

Вопросы для обсуждения:

Какие инструменты вы используете для извлечения данных из PDF?

Как решаете проблему нормализации данных?

Есть ли опыт с GEO (Generative Engine Optimization)?

Как измеряете ROI автоматизации?

Какие подводные камни встречали при работе с ИИ?

Поделитесь опытом в комментариях!

P.S. Это реальный кейс, а не теоретическая статья. Все цифры, проблемы и решения - из практики января 2026.

P.P.S. Следующий шаг - запуск 60 региональных поддоменов. Следите за обновлениями на agrorus.com!

? О проекте и планах

Контекст

Длительность сотрудничества: Проект с Agrorus начался не в январе 2026. Мы работаем с компанией 11 месяцев. Первые 8 месяцев (март-октябрь 2025) потратили на переделку сайта — миграцию на новую платформу, реструктуризацию, техническую оптимизацию. Это была необходимая база, без которой дальнейшая SEO-работа не имела смысла.

Январь 2026 — это этап контентной оптимизации, о котором мы рассказали в статье.

Про бюджеты

В кейсах часто пишут: “у клиента ограничен бюджет, поэтому выбрали дешёвое решение”. Это не наш случай.

Agrorus — крупная агрокомпания, способная нанять топовое агентство за миллион рублей. Вопрос не в деньгах, а в целесообразности. Зачем платить миллион за работу, которую можно сделать за 150 тысяч с тем же (или лучшим) качеством?

Наша задача — не “уложиться в скромный бюджет”, а продемонстрировать, как грамотное использование ИИ-инструментов экономит компаниям сотни тысяч рублей при сохр��нении высокого качества данных.

Roadmap публикаций

Это первая статья из серии. Сейчас февраль 2026, оптимизация завершена, но реальный эффект будем измерять месяцами. Планируем публиковать квартальные технические отчёты:

Q2 2026 (апрель): - Метрики первых 3 месяцев региональных поддоменов - Реальные цифры трафика по регионам - A/B тесты регионального vs универсального контента - Технические проблемы при масштабировании

Q3 2026 (июль): - Эффект GEO-оптимизации в продакшене - Анализ цитирований в ChatGPT/Perplexity/Google SGE - Сравнение классического SEO vs GEO трафика - Обновление pipeline автоматизации

Q4 2026 (октябрь): - Годовой технический отчёт - ROI всех этапов (8 месяцев переделки + 9 месяцев оптимизации) - Что сработало / что провалилось - Open-source релиз основных скриптов

Для разработчиков

Код из статьи — упрощённые примеры для понимания подхода. Боевой код сложнее (обработка ошибок, логирование, мониторинг, etc).

Если интересно глубже погрузиться в технические детали: - Пишите в комментариях — сделаем deep-dive статьи по отдельным компонентам - Подписывайтесь — будем делиться не только успехами, но и фейлами

Stay tuned! ?

Следующая техническая статья — апрель 2026.

Автор: Олег Линьков, CEO & Tech Lead Webformula.

Мы переводим агромаркетинг с "интуиции" на рельсы Data-Driven & AI. Разрабатываем и внедряем федеративные архитектуры данных и методологию DSAC (Dynamic Seasonally-Adaptive Content).

-

Мой стек: Python, 1C-Bitrix, LLM-интеграции.

-

Моя цель: Создать единый стандарт обмена данными между вендорами и дилерами в сельском хозяйстве.

-

Кому принадлежит Perplexity AI?

-

Как работает Perplexity AI?

-

Является ли Perplexity AI точным?

-

Может ли Perplexity AI помочь с конкретными задачами или вопросами?

-

Является ли Perplexity AI бесплатным сервисом?

-

Можно ли использовать Perplexity AI на мобильных устройствах?

-

Доступен ли Perplexity AI на разных языках?

-

Как начать работу с Perplexity AI?

Войти в Perplexity AI

- Появление нового подхода к поиску и обработке информации, который меняет наши представления о работе с знаниями. Perplexity AI — это не просто

Что такое Perplexity AI

- Perplexity AI — это не просто еще один чат-бот или поисковая система. Это интеллектуальный помощник, который сочетает в себе мощь искусственного

Регистрация Perplexity AI в России

- Perplexity AI — это современная поисковая система с искусственным интеллектом, которая помогает пользователям находить точные ответы на сложные